Inovações na Internet Brasileira - Criação de sites de sucesso

O ambiente virtual é análogo ao real. Assim como no ambiente real as empresas são administradas por CEOs, os sites são administrados por WebMasters. O grande diferencial dessas duas atmosferas é que o Administrador de uma empresa, seja ela uma padaria, ou uma grande corporação, não tem que construir o prédio, a caixa registradora, o mostruário, ou seja, não tem que construir o aparato operacional que ele administrará. Já no ambiente virtual, a quase totalidade dos WebMasters é quem cuida da construção de tudo. O Webmaster é o responsável pela arquitetura, gerenciamento e publicidade do projeto. É claro, e vale ressaltar, que estamos pensando em empreendimentos que NASCEM na internet e que têm como foco principal a própria internet. Não estou me referindo aqui à sites que projetam uma empresa do mundo real na internet. Estou me referindo à projetos que nascem na internet. Por esses projetos leia-se um Blog, um Site que lança algum produto à internautas (como o Digg, o Technorati), etc...etc...

O ambiente virtual é análogo ao real. Assim como no ambiente real as empresas são administradas por CEOs, os sites são administrados por WebMasters. O grande diferencial dessas duas atmosferas é que o Administrador de uma empresa, seja ela uma padaria, ou uma grande corporação, não tem que construir o prédio, a caixa registradora, o mostruário, ou seja, não tem que construir o aparato operacional que ele administrará. Já no ambiente virtual, a quase totalidade dos WebMasters é quem cuida da construção de tudo. O Webmaster é o responsável pela arquitetura, gerenciamento e publicidade do projeto. É claro, e vale ressaltar, que estamos pensando em empreendimentos que NASCEM na internet e que têm como foco principal a própria internet. Não estou me referindo aqui à sites que projetam uma empresa do mundo real na internet. Estou me referindo à projetos que nascem na internet. Por esses projetos leia-se um Blog, um Site que lança algum produto à internautas (como o Digg, o Technorati), etc...etc...Então, a grande adversidade para à elaboração de um projeto reside na necessidade do GERENTE ser o "mestre de obras"do seu empreendimento. Esse elemento restringe a questão de criatividade dos sites pois o universo de pessoas que tem potencial para criar alguma coisa realmente inovadora (e essa redundância é necessária porque atualmente o que mais vemos são os criadores de coisas nada inovadoras - os criadores do óbvio) se restringe drásticamente.

A possibilidade de itens inovadores se restringe uma vez que só os progamadores, só as pessoas que têm conhecimento acerca de web programming tem o poder de elaboração de sites. Muitas pessoas que tem um grande potencial criativo deixam de criar sites por esbarrarem nessa barreira.

É claro que, como eu disse no post Webmaster? Será?, várias plataformas existem para justamente inibir esse problema. Wordpress, Joomla, etc... possibilitam, talvez, uma diminuição dessa barreira restritiva. Porém, o desconhecimento de tais plataformas é muito grande (e talvez essa seja a razão de ser do E-Opportunities). A partir da difusão dessas plataformas, mais pessoas entrariam no ramo de Web Business, para possibilitar mais itens inovadores e de qualidade.

Mas infelizmente o desconhecimento prevalesce e muitas pessoas que tem alto poder de criatividade são afastadas por questões de conotação técnica. Assim a Internet Brasileira apresenta baixos índices de sites que nascem exclusivamente da e para internet.

Então a idéia central desse post é:

A internet brasileira está em processo de expansão. Esse momento é altamente favorável à novas criações, porém a questão da programação em web ainda afasta muita gente criativa. Graças à sites de relacionamentos, que arraigaram na cultura do brasileiro (Como o Orkut), novas assinaturas de internet banda larga foram feitas, e mais pessoas foram inseridas na "cultura da web". Com mais pessoas acessando todos os dias, e comprando mais via internet ( as vendas online somaram nos primeiros seis meses de 2006 1,75 bilhão de reais, aumento de 80 por cento frente aos 974 milhões de reais registrado na primeira metade de 2005 - Fonte: Info Online 23/11/2006 ), o espaço para o nascimento de sites e de aumento de publicidade em sites fica altamente favorável.Com a restrição da criatividade na nossa web. O que fazer?

Alternativas bem legais se mostram viáveis quando falamos em abrir novos sites. Não precisamos ficar quebrando a cabeça todos os dias na busca por inovações e por uma idéia que vá revolucionar a Web Brasileira. Podemos buscar outras alternativas para conseguir montar um site de ótima qualidade e de um bom número de visitantes.

Talvez a grande prova disso sejam os sites Submarino, Mercado Livre, Rec6 (assim como EuCurti, Linkk) e o Contraditorium.

O Submarino é o nosso Amazon.

O Mercado Livre nasceu da iniciativa de um argentino que foi fazer um Mestrado nos Estados unidos. E que absorveu a concepção do eBay, e lançou um projeto audaz na américa latina.

O Rec6 (assim como o EuCurti e o Linkk) representam o Digg.

O Contraditorium uma espécie de ProBlogger só que do Brasil.

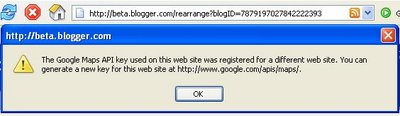

E mais recentemente o BlogBlogs que vai buscar oferecer as facilidades para Bloggers assim como o Technorati. Porém ainda está em fase de testes e quase nada funciona.

Então podemos ver que muitas vezes as receitas de sucessos de outros países podem ser implementadas no nosso ambiente virtual (Brasileiro) e, assim como os principais, podem gerar não só muitos lucros como muita satisfação em ter um bom projeto.

A grande ressalva é com relação à CopyRights, mas na maior parte das vezes, a instituição de um site relacionado, que capta a idéia central, não se constitui em crime contra a propriedade intelectual. Então a incorporação de sites que só existem em outras línguas é uma boa alternativa para a construção de sites de boa qualidade.

O E-Opportunities voltou após uma semana de recesso festivo, e após a publicação desse post retoma o recesso voltando a partir do dia 2 de Janeiro.

Para você, um Feliz Ano Novo, um 2007 repleto de sucesso, saúde e felicidade.

Não percam as novidades de 2007!!!